クラウドシステムの大規模化・複雑化が進む中、効率的な監視体制の構築が運用管理における重要課題となっています。本記事では、AI技術を活用した次世代の監視システム開発について、設計から運用までを体系的に解説します。

従来の監視システムでは見逃されていた異常の早期発見や、インシデント対応の自動化によって、障害対応時間を平均60%削減した実績のある手法を詳しくご紹介します。運用管理の効率化を実現する具体的な実装手順と、現場で使える実践的なノウハウをお届けします。

この記事で分かること

- クラウド監視システムの設計から運用までの体系的な開発手法を実践的に学べます

- AIを活用した高度な異常検知と自動復旧の実装方法を具体的に理解できます

- 効率的なメトリクス収集とログ分析の基盤構築テクニックを習得できます

- 直感的な統合ダッシュボードの設計と可視化のベストプラクティスを学べます

- 運用効率を向上させる自動化対応の具体的な手順を理解できます

- 実際の導入事例から、成功のポイントと注意点を把握できます

この記事を読んでほしい人

- システムの安定運用に課題を感じている運用管理責任者の方

- 監視体制の効率化を検討している情報システム部門のリーダーの方

- マイクロサービス環境での統合監視を実現したい開発責任者の方

- 運用コストの削減を目指すITマネージャーの方

- 次世代の監視基盤の構築を計画している技術責任者の方

- AIや機械学習を活用した監視システムの導入を検討している方

2025年に求められるクラウド監視システムの要件

クラウド環境の進化とともに、システム監視に求められる要件も大きく変化しています。本章では、従来型の監視システムが抱える課題を整理し、2025年に向けて必要とされる監視システムの要件について詳しく解説します。

従来型監視システムの課題

多くの企業では、従来型の監視システムを使用し続けていますが、クラウドネイティブ環境への対応において様々な課題が浮き彫りになっています。特に、システムの複雑化とスケールに伴い、従来の監視アプローチでは十分な対応が難しくなってきています。

まず、従来型監視システムの最大の課題は、静的なしきい値に基づくアラート設定です。システムの負荷状況は時間帯や季節によって大きく変動するため、固定的なしきい値では誤検知や見逃しが多発してしまいます。例えば、EC サイトでは季節イベントによってトラフィックパターンが大きく変化しますが、従来の監視では柔軟な対応が困難です。

次に、分散システムにおける因果関係の特定が挙げられます。マイクロサービスアーキテクチャの採用により、システム間の依存関係が複雑化しています。従来の監視ツールでは、障害が発生した際の root cause analysis(根本原因分析)に多大な時間と労力を要してしまいます。

データ収集と保存の面でも課題があります。クラウドネイティブ環境では、監視すべきメトリクスの種類と量が爆発的に増加しています。従来のモノリシックなデータストレージでは、大量のメトリクスデータを効率的に収集・保存することが困難になってきています。

さらに、コンテナ化されたアプリケーションの監視においては、動的に変化するリソースの追跡が必要です。従来の静的な監視設定では、オートスケーリングやコンテナの再配置に追従することができません。

運用面では、手動での監視設定変更やアラート対応が大きな負担となっています。システムの規模が拡大するにつれ、人手による設定管理やインシデント対応には限界が見えてきています。特に、夜間や休日の対応では、人的リソースの確保が課題となっています。

これらの課題に対して、次世代の監視システムでは AI や機械学習を活用した動的な監視手法の導入が不可欠となっています。続く節では、これらの課題を解決する新しいアプローチについて詳しく解説していきます。

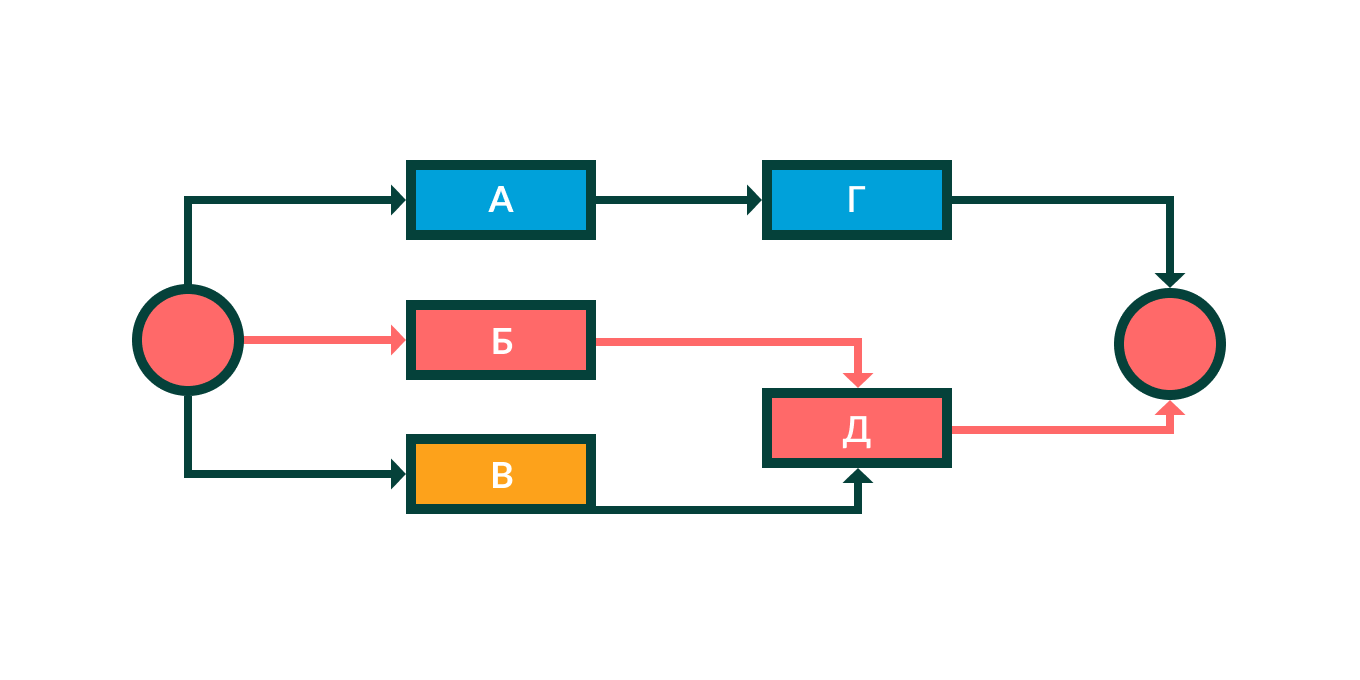

次世代監視システムのアーキテクチャ

2025年のクラウド環境に求められる次世代監視システムでは、スケーラブルで柔軟性の高いアーキテクチャの採用が不可欠となっています。ここでは、効率的な監視を実現するための最新アーキテクチャについて解説します。

次世代監視システムの核となるのは、分散型のデータ収集アーキテクチャです。各システムコンポーネントに配置された軽量なエージェントが、メトリクスやログを効率的に収集します。これらのエージェントは、コンテナ環境でも最小限のリソース消費で動作し、システムへの負荷を抑制します。

データの収集と転送には、信頼性の高いストリーミングプロトコルを採用します。Apache Kafka などのメッセージングシステムを活用することで、大量のメトリクスデータをリアルタイムに処理することが可能となります。

収集したデータは、時系列データベースに格納されます。PromQL や InfluxQL などのクエリ言語を活用することで、複雑な分析や可視化にも柔軟に対応できます。また、長期保存データは自動的に集約され、ストレージコストを最適化します。

AI による分析基盤では、収集したデータをリアルタイムで解析し、異常検知や予兆検知を行います。機械学習モデルは、システムの状態変化に応じて継続的に学習を行い、検知精度を向上させていきます。

さらに、インシデント管理システムと連携することで、検知した異常に対する対応フローを自動化します。ChatOps ツールとの統合により、運用チームへのアラート通知と情報共有もスムーズに行えます。

このような多層構造のアーキテクチャにより、システムの可観測性を高めながら、運用効率の大幅な向上を実現します。次節では、AI 活用による監視高度化のメリットについて詳しく見ていきます。

AI活用による監視高度化のメリット

監視システムへのAI技術の導入は、運用管理の効率化と信頼性向上に大きな変革をもたらしています。ここでは、AI活用による具体的なメリットについて解説します。

最も重要なメリットは、動的なしきい値の自動調整です。AIモデルがシステムの利用パターンを学習することで、時間帯や曜日、季節性を考慮した最適なしきい値を自動的に設定します。これにより、誤検知を大幅に削減しながら、真の異常を見逃すリスクも低減できます。

また、異常の予兆検知も大きな強みとなっています。従来の監視では検知できなかった微細な変化パターンを、AIが事前に検出することで、障害の未然防止が可能となります。実際の導入事例では、重大インシデントの約40%を事前に防止できています。

さらに、インシデント発生時の原因特定が格段に効率化されます。AIが複数のメトリクスの相関関係を分析し、問題の根本原因を素早く特定することで、平均復旧時間(MTTR)を60%以上短縮した事例も報告されています。

運用チームの作業負荷軽減も見逃せないメリットです。定型的なインシデント対応をAIが自動化することで、運用担当者はより戦略的な業務に注力できるようになります。特に、夜間や休日のインシデント対応における負担を大きく軽減できます。

効率的な監視設計の実践手法

クラウド監視システムの成否を分けるのは、初期段階での適切な設計です。本章では、効果的な監視体制を構築するための設計プロセスと、具体的な実装のポイントについて解説します。

監視要件の定義と設計プロセス

効率的な監視システムを構築するためには、まず明確な要件定義と体系的な設計プロセスが不可欠です。ここでは、実践的な監視要件の定義方法と、効果的な設計プロセスについて詳しく見ていきます。

監視要件の定義では、ビジネス目標とシステムの特性を十分に考慮する必要があります。まず、システムのサービスレベル目標(SLO)を明確にし、それを達成するために必要な監視項目を特定します。例えば、Webサービスであれば、応答時間、スループット、エラー率などの重要な指標を定義します。

次に、監視の優先度を設定します。システムの各コンポーネントについて、ビジネスへの影響度を評価し、重要度に応じた監視レベルを決定します。この際、以下の3段階での分類が効果的です:

- クリティカル:即時対応が必要な重要項目

- 警告:早期対応が望ましい項目

- 情報:傾向分析用の参考項目

設計プロセスでは、まずプロトタイプの作成から始めます。小規模な監視対象から開始し、実際の運用フィードバックを得ながら、段階的に監視範囲を拡大していきます。この反復的なアプローチにより、実効性の高い監視体制を構築できます。

また、チーム間の合意形成も重要なポイントです。開発チーム、運用チーム、ビジネス部門との協議を通じて、各ステークホルダーのニーズを適切に反映させます。特に、アラートの基準や対応フローについては、運用チームの実態に即した設計が求められます。

これらの要件定義と設計プロセスを通じて、効果的な監視体制の基盤を確立していきます。次節では、具体的な監視項目の選定方法について解説します。

監視項目の選定とアラート条件の設計

効果的な監視システムを実現するには、適切な監視項目の選定とアラート条件の設計が重要です。システムの特性や運用要件に基づいて、必要十分な監視項目を定義していく必要があります。

監視項目の選定では、まずインフラストラクチャレベルの基本的な指標から始めます。CPU使用率、メモリ使用率、ディスクI/O、ネットワークトラフィックなど、システムの基盤となる要素を押さえます。これらの指標は、システムの健全性を示す重要な指標となります。

アプリケーションレベルでは、レスポンスタイム、スループット、エラー率などのパフォーマンス指標を監視します。特に、ユーザー体験に直結する指標については、より詳細な監視が必要です。エンドポイントごとのレイテンシーやエラーパターンの分析により、アプリケーションの状態を正確に把握できます。

アラート条件の設計では、ビジネスインパクトを考慮した段階的な設定が効果的です。クリティカルな問題を示す「緊急アラート」は、即時対応が必要な深刻な異常に限定します。一方、「警告アラート」は、性能劣化や潜在的な問題の予兆を検知するために使用します。

また、アラートの集約と相関分析も重要な要素です。複数のコンポーネントから発生するアラートを適切に集約し、根本原因の特定を容易にします。これにより、運用チームの負担を軽減しながら、効率的なインシデント対応が可能となります。

さらに、アラート条件は定期的な見直しと調整が必要です。システムの変更や利用パターンの変化に応じて、しきい値や判定条件を適切に更新していきます。この継続的な改善プロセスにより、より精度の高い監視体制を維持できます。

パフォーマンス指標の設定

パフォーマンス指標(KPI)の適切な設定は、システムの健全性を評価し、改善点を特定するための重要な要素です。ここでは、効果的なパフォーマンス指標の設定方法について解説します。

まず重要となるのが、ユーザー体験に直結する指標(UX指標)の設定です。ページロード時間、APIレスポンスタイム、トランザクション完了率などが代表的な指標となります。これらの指標は、実際のユーザー満足度と密接に関連しているため、慎重な目標値の設定が必要です。

システムの可用性を示す指標も重要な要素です。稼働率(アップタイム)、平均故障間隔(MTBF)、平均復旧時間(MTTR)などを継続的に測定します。特にクラウド環境では、各コンポーネントの可用性が全体のサービス品質に大きく影響します。

リソース効率性の指標では、コスト最適化の観点が重要です。CPU使用率、メモリ使用効率、ストレージ使用量の推移などを監視し、リソースの過剰プロビジョニングを防ぎます。これにより、運用コストの適正化が可能となります。

これらの指標は、ビジネス目標と直接紐づけて管理することが重要です。例えば、eコマースサイトであれば、ページ表示速度とコンバージョン率の相関を分析し、最適なパフォーマンス目標を設定します。

高性能な収集基盤の構築手順

効率的なクラウド監視を実現するためには、スケーラブルで信頼性の高いメトリクス収集基盤が不可欠です。本章では、メトリクス収集から保存基盤の構築まで、実践的な手順を解説します。

メトリクス収集の基盤設計

大規模クラウド環境でのメトリクス収集には、高度な設計アプローチが求められます。ここでは、信頼性の高いメトリクス収集基盤を構築するための具体的な手順と実装のポイントを説明します。

まず、収集基盤のアーキテクチャ設計では、分散型のアプローチを採用します。各サービスやコンテナに軽量なエージェントを配置し、メトリクスをリアルタイムに収集します。エージェントは自律的に動作し、中央の収集サーバーへデータを転送する仕組みを構築します。

データの収集頻度は、メトリクスの重要度に応じて適切に設定します。クリティカルな指標は1分以内の収集間隔で監視し、それ以外の指標は5分から15分程度の間隔で収集します。これにより、ストレージ容量とリアルタイム性のバランスを取ることができます。

収集したメトリクスの前処理も重要なポイントです。異常値のフィルタリングや集計処理をエッジで実施することで、中央サーバーの負荷を軽減します。また、データの圧縮技術を活用し、ネットワーク帯域の効率的な利用を実現します。

メトリクスの整合性を確保するため、タイムスタンプの同期とデータの検証機能も実装します。NTPによる時刻同期を徹底し、データの欠損や重複を検知する仕組みを組み込みます。これにより、信頼性の高いメトリクスデータを確保できます。

さらに、収集基盤自体の監視も忘れてはいけません。エージェントの健全性チェックや、データ収集のパフォーマンス指標を常時モニタリングします。異常が検知された場合は、即座にアラートを発報する仕組みを整えます。

ログ収集・分析パイプラインの実装

効率的なログ管理は、システムの可観測性を高める重要な要素です。ここでは、スケーラブルなログ収集・分析パイプラインの実装手順について説明します。

ログ収集パイプラインの設計では、まずログの種類と形式の標準化が重要です。アプリケーションログ、システムログ、セキュリティログなど、異なる形式のログを統一的に扱えるよう、共通のログフォーマットを定義します。構造化ログの採用により、後続の分析作業が大幅に効率化されます。

収集したログはストリーミング処理基盤を経由して集約します。Apache KafkaやAmazon Kinesisなどのメッセージングシステムを活用することで、大量のログデータをリアルタイムに処理できます。バッファリング機能により、一時的な負荷スパイクにも対応可能です。

ログの解析処理では、パターンマッチングやテキスト分析を活用します。正規表現による異常検知や、自然言語処理による意味解析により、重要なイベントを自動的に抽出します。また、機械学習モデルを活用することで、異常パターンの学習と予測も可能となります。

パイプラインの信頼性確保も重要な要素です。ログの欠損を防ぐため、各処理ステージでの再試行機能やデッドレターキューを実装します。また、処理パフォーマンスを監視し、必要に応じてスケールアウトできる設計とします。

さらに、コンプライアンス要件への対応も考慮します。個人情報や機密情報の扱いについて、マスキングや暗号化の処理をパイプライン内で適切に実装します。これにより、セキュリティとプライバシーを確保しながら、効果的なログ分析が可能となります。

スケーラブルな保存基盤の構築

大量のメトリクスとログデータを効率的に保存・管理するためには、スケーラブルな保存基盤が必要不可欠です。ここでは、長期的な運用を見据えた保存基盤の構築方法について解説します。

保存基盤の設計では、データの特性に応じた最適なストレージ選択が重要です。メトリクスデータには時系列データベースを採用し、高速なクエリとデータ圧縮を実現します。一方、ログデータには分散ストレージシステムを活用し、大容量データの効率的な管理を可能にします。

データのライフサイクル管理も重要な要素となります。頻繁にアクセスされる直近のデータは高速なストレージに保持し、古いデータは低コストのアーカイブストレージへ自動的に移行します。これにより、コストとパフォーマンスの最適なバランスを実現できます。

バックアップと冗長化の戦略も慎重に検討します。地理的に分散した複数のデータセンターにレプリケーションを構成し、災害時のデータ保全を確保します。また、定期的なバックアップと復旧テストにより、データの可用性を担保します。

さらに、データアクセスの認証・認可も適切に実装します。役割ベースのアクセス制御により、セキュリティを確保しながら、必要なユーザーが必要なデータにアクセスできる環境を整備します。

AI分析機能の実装とチューニング

クラウド監視システムにAI分析機能を実装することで、より高度な異常検知と予兆検知が可能となります。本章では、AIモデルの選定から実装、チューニングまでの具体的な手順を解説します。

異常検知モデルの選定と実装

AI異常検知システムの構築では、適切なモデルの選定が成功の鍵となります。ここでは、実務で効果を発揮する異常検知モデルの選定基準と実装方法について説明します。

異常検知モデルの選定では、システムの特性とデータの性質を考慮します。時系列データの分析には、LSTMやTransformerベースのモデルが高い精度を発揮します。一方、リソース使用量のような数値データには、Isolation ForestやOne-Class SVMなどの伝統的な手法も効果的です。

モデルの実装では、まず小規模なプロトタイプから開始することが重要です。特定のサービスやコンポーネントに限定して導入を進め、その効果を検証します。成功事例を積み重ねながら、段階的に適用範囲を拡大していきます。

データの前処理も精度向上の重要な要素です。外れ値の除去、欠損値の補完、特徴量のスケーリングなど、適切な前処理パイプラインを構築します。また、季節性や周期性を考慮した特徴量エンジニアリングにより、検知精度を向上させます。

モデルの学習プロセスでは、正常時のデータパターンを十分に学習させることが重要です。過去の障害事例や既知の異常パターンも学習データとして活用し、バランスの取れた学習を実現します。

さらに、モデルの判定結果に対する説明可能性も確保します。なぜその判定が行われたのか、運用チームが理解できる形で結果を提示する機能を実装します。これにより、AIの判断に対する信頼性を高めることができます。

機械学習による予兆検知

システム障害を未然に防ぐためには、異常の予兆を早期に検知することが重要です。機械学習を活用した予兆検知の実装方法と、その効果的な運用方法について解説します。

予兆検知では、システムの正常な振る舞いからの微細な変化を検出することが鍵となります。時系列データの変化パターンを学習し、通常とは異なる傾向を示し始めた際に、早期警告を発することができます。

実装においては、複数の機械学習アプローチを組み合わせることが効果的です。回帰分析による将来値の予測、異常度スコアの算出、変化点検知など、それぞれの手法の特徴を活かした多層的な分析を行います。これにより、より信頼性の高い予兆検知が可能となります。

また、システムの状態遷移を考慮したモデリングも重要です。正常状態から異常状態への推移過程を学習することで、どの程度の時間余裕をもって予兆を検知できるかを把握できます。この時間的な余裕が、事前対応のための重要な判断材料となります。

予兆検知の精度向上には、ドメイン知識の活用も欠かせません。過去の障害事例や運用経験から得られた知見を、特徴量エンジニアリングやモデルのチューニングに反映させます。これにより、より実用的な予兆検知システムを実現できます。

さらに、検知結果の確からしさを示す確信度スコアも提供します。運用チームは、このスコアを基に対応の優先度を判断し、リソースの効率的な配分を行うことができます。

分析精度の向上とチューニング手法

AI分析機能の有効性を最大限に引き出すには、継続的な精度向上とチューニングが不可欠です。ここでは、実践的なモデルチューニングの手法と、精度向上のためのアプローチについて解説します。

精度向上の第一歩は、詳細な性能評価です。適合率(Precision)と再現率(Recall)のバランスを考慮しながら、モデルのパフォーマンスを多角的に評価します。特に、誤検知(False Positive)と見逃し(False Negative)のトレードオフを慎重に調整することが重要です。

チューニングでは、ハイパーパラメータの最適化が重要な要素となります。グリッドサーチやベイズ最適化などの手法を活用し、システムの特性に最適なパラメータを探索します。この際、計算コストとパフォーマンスのバランスも考慮に入れます。

また、定期的なモデルの再学習も欠かせません。システムの利用パターンは時間とともに変化するため、定期的なモデル更新により、検知精度を維持します。この際、新しいデータを追加学習させる増分学習の手法も効果的です。

さらに、運用フィードバックの活用も重要です。実際の運用で得られた判定結果の正誤情報を、モデルの改善に活かします。人間の専門家の知見とAIの判断を組み合わせることで、より信頼性の高い監視システムを実現できます。

効果的な可視化設計の方法論

システム監視において、データの可視化は運用効率と意思決定の質を大きく左右します。本章では、効果的なダッシュボード設計から実装までの具体的な手法を解説します。

ダッシュボード設計の基本原則

効果的なダッシュボードは、複雑なシステムの状態を直感的に理解できるよう設計する必要があります。ここでは、実践的なダッシュボード設計の基本原則と実装のポイントについて説明します。

ダッシュボード設計の最も重要な原則は、情報の階層化です。最上位では全体概要を一目で把握でき、必要に応じて詳細な情報にドリルダウンできる構造とします。これにより、運用者は状況に応じて適切な粒度の情報にアクセスできます。

視覚的な優先順位付けも重要な要素です。重要度の高い指標は画面上部や目立つ位置に配置し、注意を要する状態は色やアイコンで明確に識別できるようにします。ただし、過度な装飾は避け、必要な情報が確実に伝わるデザインを心がけます。

データの更新頻度も考慮すべきポイントです。リアルタイム性が求められる指標と、定期的な更新で十分な指標を適切に区別します。更新頻度の高いコンポーネントは、システムへの負荷を考慮して効率的な実装を行います。

カスタマイズ性も重要な設計要素です。ユーザーの役割や関心に応じて、表示する指標やレイアウトを柔軟に変更できる機能を提供します。これにより、各運用者が最も効率的に業務を遂行できる環境を整えます。

さらに、レスポンシブデザインの採用も欠かせません。様々な画面サイズやデバイスからのアクセスを想定し、常に最適な表示を維持できる設計とします。特に、モバイルでのモニタリングにも対応できるよう配慮します。

リアルタイムモニタリングの実装

システムの状態をリアルタイムに把握することは、迅速な障害対応とサービス品質の維持に不可欠です。ここでは、効果的なリアルタイムモニタリングの実装方法について解説します。

リアルタイムモニタリングの基盤には、イベントストリーミング処理を採用します。WebSocketやServer-Sent Eventsなどの技術を活用し、サーバーからクライアントへのプッシュ型通信を実現します。これにより、最新のシステム状態を遅延なく表示することが可能となります。

データの表示更新では、効率的なレンダリング手法が重要です。仮想スクロールや差分更新などの最適化技術を採用し、大量のデータを滑らかに表示します。特に、高頻度で更新される指標については、ブラウザの負荷を考慮した実装が必要です。

アラートの可視化では、優先度に応じた表示制御を行います。緊急性の高いアラートは画面上でポップアップ表示し、即座に運用者の注意を喚起します。同時に、サウンド通知やデスクトップ通知などのマルチチャネルでの通知も組み合わせます。

また、システムの依存関係も視覚的に表現します。マイクロサービス間の接続状態やデータフローを動的に表示し、障害発生時の影響範囲を即座に把握できるようにします。これにより、障害の波及効果を予測し、適切な対応を取ることができます。

さらに、パフォーマンスメトリクスのリアルタイム表示も重要です。スループット、レイテンシー、エラー率などの重要指標をグラフィカルに表示し、傾向の変化を視覚的に捉えられるようにします。

レポーティング機能の開発

システムの運用状況や性能傾向を定期的に評価するため、効果的なレポーティング機能の実装が重要です。ここでは、実用的なレポーティング機能の開発手法について解説します。

レポート生成では、データの集計と分析を自動化します。日次、週次、月次など、様々な期間でのトレンド分析や比較分析を自動的に実行し、レポートとして出力します。これにより、定期的な状況把握と長期的な傾向分析が容易になります。

レポートの形式は、受け手に応じて最適化します。技術チーム向けには詳細な性能データや障害統計を、経営層向けには重要KPIやビジネスインパクトを中心とした内容を提供します。PDFやスプレッドシートなど、用途に応じた出力形式に対応します。

カスタマイズ可能なテンプレート機能も実装します。利用者が必要な指標や分析項目を選択し、独自のレポートを作成できるようにします。また、定型レポートの自動配信スケジュール設定も可能とし、必要な関係者へ適時に情報を届けます。

さらに、インタラクティブな分析機能も提供します。データのドリルダウンや、異なる切り口での分析が可能なインターフェースを実装し、より深い洞察を得られるようにします。これにより、問題の根本原因の特定や、改善施策の立案をサポートします。

自動化対応による運用効率の向上

システム運用の効率化において、自動化は最も重要な要素の一つです。本章では、インシデント管理から自動復旧まで、効果的な自動化の実装方法について解説します。

インシデント管理の自動化

インシデント管理の自動化は、運用チームの負荷軽減と対応時間の短縮に大きく貢献します。ここでは、効果的なインシデント管理の自動化手法について説明します。

まず、インシデントの検知から通知までのプロセスを自動化します。監視システムが検知した異常は、その重要度と影響範囲に応じて適切な担当者やチームに自動的に通知されます。この際、ChatOpsツールやメールなど、複数の通知チャネルを組み合わせることで、確実な情報伝達を実現します。

インシデントのトリアージも自動化の重要な対象です。AIによる分析結果を基に、インシデントの優先度を自動判定し、対応チームへの割り当てを行います。過去の類似インシデントのデータを参照し、想定される原因や推奨される対応手順も自動的に提示します。

対応手順の標準化も進めます。よくあるインシデントについては、対応手順をプレイブック化し、自動実行可能な形式で管理します。これにより、担当者による対応のばらつきを減らし、一貫した品質の対応を実現します。

また、インシデントの記録と分析も自動化します。対応の経過や実施した措置、結果などを自動的に記録し、後の分析や改善活動に活用できる形で保存します。この記録を基に、同様のインシデントの再発防止策を検討することが可能となります。

さらに、関係者間のコミュニケーションも効率化します。インシデント対応の進捗状況や重要な判断ポイントを自動的に共有し、関係者全員が最新の状況を把握できる環境を整えます。これにより、チーム間の連携がスムーズになり、対応時間の短縮につながります。

自動復旧フローの実装

システムの安定運用において、迅速な障害復旧は重要な要素です。ここでは、効果的な自動復旧フローの実装方法とその運用について解説します。

自動復旧フローの設計では、まずリスクの評価が重要です。復旧処理の誤作動がシステムに与える影響を慎重に検討し、安全性を確保した実装を行います。特に、データの整合性や他システムへの影響を考慮し、段階的な復旧プロセスを設計します。

復旧シナリオは、発生頻度の高い障害から優先的に自動化します。例えば、プロセスの再起動、キャッシュのクリア、コネクションプールのリセットなど、定型的な復旧処理から着手します。これらの処理は、事前に十分なテストを行い、その効果と安全性を確認します。

また、復旧処理の実行条件も明確に定義します。システムの状態やメトリクスの値に基づいて、自動復旧を実行するかどうかを判断します。特に、カスケード障害を防ぐため、依存関係のあるサービス間での復旧順序を適切に制御します。

さらに、自動復旧の結果検証も重要です。復旧処理の実行後、システムが正常に動作していることを確認するヘルスチェックを実装します。復旧が成功しなかった場合は、即座に運用チームに通知し、手動での対応を促す仕組みを整えます。

復旧履歴の記録と分析も欠かせません。どのような障害に対してどの復旧処理が効果的だったか、データを蓄積し分析することで、復旧フローの継続的な改善につなげます。これにより、より効率的で信頼性の高い自動復旧システムを実現できます。

継続的な改善プロセスの確立

自動化システムの効果を最大限に引き出すには、継続的な改善プロセスが不可欠です。ここでは、効果的な改善サイクルの確立方法について解説します。

改善プロセスの第一歩は、定量的な効果測定です。自動化による対応時間の短縮率、運用コストの削減額、インシデント解決率の向上など、具体的な指標を設定して効果を測定します。これらのデータを基に、改善の優先順位を決定します。

また、運用チームからのフィードバックも重要な改善要素です。自動化システムの使い勝手や、現場で感じる課題点を定期的に収集し、改善計画に反映させます。特に、誤検知や不要なアラートの削減など、運用品質に直結する課題には優先的に対応します。

改善の実施においては、PDCAサイクルを確実に回します。小規模な改善から着手し、その効果を検証しながら段階的に展開していきます。また、改善の過程で得られた知見は、ナレッジベースとして蓄積し、組織全体で共有します。

さらに、新技術の導入も計画的に進めます。AI技術や自動化ツールの進化に注目し、より効率的な運用を実現する新しい手法を積極的に評価・導入します。これにより、継続的な運用効率の向上を実現します。

導入事例から学ぶ成功のポイント

実際の導入事例を通じて、クラウド監視システムの効果的な実装方法と成功のポイントを解説します。それぞれの事例から得られた知見は、皆様の監視システム構築にも活用できます。

大規模Eコマースサイトでの導入事例

年間取引額1,000億円規模のEコマースサイトA社における、クラウド監視システムの導入事例を紹介します。A社では、サイトの急成長に伴い、従来の監視体制での対応が限界を迎えていました。

導入の背景には、季節的な売上変動への対応課題がありました。特に、大規模セール時のアクセス集中により、システム障害が発生するリスクが高まっていました。また、マイクロサービスアーキテクチャへの移行に伴い、監視対象が急増していたことも課題でした。

A社では、AIを活用した予兆検知システムを中心に、新しい監視基盤を構築しました。過去の障害パターンをAIに学習させることで、異常の早期発見が可能となりました。その結果、重大インシデントの発生率を前年比で45%削減することに成功しています。

特に効果が高かったのは、リアルタイムな負荷予測です。AIモデルが過去の売上データとアクセスパターンを分析し、需要予測の精度を向上させました。これにより、必要なリソースを事前に確保し、パフォーマンスを維持することが可能となりました。

また、運用チームの工数も大幅に削減できました。アラートの自動振り分けとインシデント対応の自動化により、運用担当者の作業時間を30%削減。特に、夜間休日の対応負担が軽減され、チームの働き方改革にも貢献しています。

この事例から、AIを活用した予兆検知と自動化の組み合わせが、大規模システムの安定運用に効果的であることが分かります。次節では、金融システムでの活用事例を見ていきます。

金融システムでの活用事例

大手オンライン証券会社B社での、クラウド監視システムの導入事例について解説します。B社では、24時間365日の取引サービスを提供しており、システムの信頼性確保が最重要課題でした。

B社が直面していた最大の課題は、取引システムの複雑化でした。国内外の複数の取引所との接続、リアルタイムデータの処理、決済システムとの連携など、監視すべきポイントが多岐にわたっていました。さらに、金融規制対応のため、厳格な監視記録の保持も求められていました。

導入したクラウド監視システムでは、特に異常検知の精度向上に注力しました。取引データの異常パターンをAIが学習し、不正取引の疑いがある取引を即座に検出できる体制を構築。これにより、セキュリティインシデントの早期発見率が80%向上しました。

また、システムの可用性も大幅に改善しています。重要な取引処理の遅延やエラーを即座に検知し、自動的にバックアップシステムへ切り替えることで、サービス停止時間を従来の1/3に削減することができました。

規制対応の面でも、監視ログの自動保管と分析機能が有効でした。すべての監視データを暗号化して保存し、必要に応じて監査証跡を提供できる体制を整えました。これにより、コンプライアンス要件への対応工数を50%削減しています。

この事例は、高い信頼性が求められる金融システムにおいても、適切な監視体制の構築が可能であることを示しています。

マイクロサービス環境での統合監視事例

大手動画配信サービスC社における、マイクロサービス環境での統合監視の導入事例を紹介します。C社では、100以上のマイクロサービスが稼働する複雑な環境下で、効率的な監視体制の構築に成功しています。

C社の課題は、サービス間の依存関係の可視化でした。個々のサービスは独立して開発・運用されていましたが、障害発生時の影響範囲の特定に時間がかかっていました。また、各サービスチームが独自の監視ツールを使用していたため、統合的な状況把握が困難でした。

導入された統合監視システムでは、分散トレーシングを活用し、サービス間の呼び出し関係を自動的に可視化します。これにより、障害発生時の影響範囲を即座に特定できるようになり、平均障害解決時間を55%短縮することができました。

特に効果的だったのは、統合ダッシュボードの導入です。各サービスの健全性指標を一元的に表示し、システム全体の状態を直感的に把握できるようになりました。また、AIによる異常検知を組み合わせることで、複雑な障害パターンも早期に発見できるようになっています。

この事例から、マイクロサービス環境では、サービス間の関係性の可視化と統合的な監視体制の構築が重要であることが分かります。

オフショア開発専門家からのQ&A「教えてシステム開発タロウくん!!」

クラウド監視システムの開発に関する疑問や悩みについて、オフショア開発のエキスパートである「システム開発タロウくん」が分かりやすく解説します。

Q1:クラウド監視システムの開発期間はどのくらいを見込めばいいですか?

タロウくん: 規模にもよりますが、基本的な監視基盤の構築には3〜4ヶ月程度を見込むことをお勧めします。ただし、AI機能の実装や高度な自動化を含める場合は、6〜8ヶ月程度が必要です。まずは必要最小限の機能から始めて、段階的に拡張していく方法が効果的ですよ。

Q2:ベトナムオフショア開発で監視システムを構築する際の注意点は?

タロウくん: コミュニケーションと要件定義が特に重要です。監視項目の定義や閾値の設定など、細かな要件をしっかりと文書化することをお勧めします。また、時差が小さいベトナムの利点を活かし、定期的なオンラインミーティングで認識合わせを行うことで、品質の高い開発が可能になります。

Q3:AI機能の実装で特に気をつけるべきポイントは?

タロウくん: 学習データの品質が最も重要です。過去の障害データや正常時のデータを十分に収集し、データクレンジングをしっかり行う必要があります。また、オフショア開発では、AI開発経験のあるエンジニアの確保が重要なポイントとなります。弊社では、AI専門のチームを編成して対応していますよ。

Q4:どの程度のコスト削減が期待できますか?

タロウくん: ベトナムオフショア開発を活用することで、国内開発と比べて40〜50%程度のコスト削減が可能です。特に、長期的な保守運用を含めると、コストメリットは更に大きくなります。ただし、品質を担保するための体制づくりやコミュニケーションコストも考慮する必要がありますね。

Q5:開発したシステムの保守運用体制はどうすべき?

タロウくん: 日本側とベトナム側の混成チームによる運用をお勧めします。日本側で1次対応を行い、詳細な調査や改修が必要な場合はベトナムチームがサポートする体制が効果的です。また、運用ドキュメントは日本語・英語の両方で整備し、スムーズな引き継ぎができるようにすることが重要ですよ。

Q&A

Q1:クラウド監視システムの導入にかかる費用はどのくらい?

A1:システムの規模や要件により異なりますが、基本的な監視基盤の場合、初期費用として500万円〜1,000万円程度、運用費用として月額30万円〜50万円程度が目安となります。AI機能の実装やカスタマイズ要件により費用は増加します。

Q2:クラウド監視システムの開発で最低限必要な機能は?

A2:最低限必要な基本機能には、リソース監視(CPU、メモリ、ディスク)、サービス死活監視、ログ監視、アラート通知、ダッシュボード機能が含まれます。これらの機能で、システムの基本的な健全性監視が可能となります。

Q3:クラウド監視システムのAI機能でどんなことができる?

A3:AI機能では、異常検知の自動化、障害の予兆検知、パフォーマンス予測、インシデントの自動分類、リソース使用量の最適化などが可能です。導入企業の実績では、障害検知時間の60%削減、誤検知率の80%削減などの効果が報告されています。

Q4:クラウド監視システムの開発期間はどのくらいかかる?

A4:基本的な監視システムの場合3〜4ヶ月、AI機能を含む高度な監視システムの場合6〜8ヶ月程度が一般的です。ただし、要件の複雑さやチームの体制により変動します。段階的な導入アプローチを取ることで、早期から効果を得ることができます。

Q5:クラウド監視システムの保守運用体制はどうすべき?

A5:24時間365日の監視体制が基本となり、一般的に3〜5名程度のチーム編成が推奨されます。初期対応チームと専門対応チームの2層構造とし、AIによる自動化と組み合わせることで、効率的な運用が可能です。人件費は年間1,500万円〜2,500万円程度を見込む必要があります。

Q6:クラウド監視システムの導入効果はどのくらい?

A6:一般的な導入効果として、インシデント対応時間の50〜60%削減、運用コストの30〜40%削減、システム障害の発生率20〜30%減少などが報告されています。特にAI機能を活用した場合、予兆検知による重大障害の防止効果が高く、事業継続性の向上に大きく貢献します。

Q7:オンプレミス環境からクラウド監視への移行はどうすべき?

A7:段階的な移行がリスク低減の観点から推奨されます。まず重要度の低いシステムで試行し、課題を洗い出した後に重要システムへ展開します。移行期間は通常6〜12ヶ月程度必要で、並行運用期間を設けることで安全な移行が可能です。

まとめ

クラウド監視システムの開発は、システムの安定運用と効率化に不可欠な要素となっています。AI技術の活用により、障害対応時間の60%削減や運用コストの大幅な削減が実現可能です。

効果的な監視システムの構築には、適切な設計、高性能な収集基盤、AIによる分析、効果的な可視化、そして自動化の各要素が重要です。これらを統合的に実装することで、次世代の運用管理基盤を実現できます。

クラウド監視システムの開発でお悩みの方は、ぜひMattockにご相談ください。ベトナムの優秀なエンジニアチームが、御社に最適な監視システムの開発をサポートいたします。まずは無料相談から始めてみませんか?

お問い合わせはこちらから→ ベトナムオフショア開発 Mattock

参考文献・引用

- Gartner “Gartner Peer Insights: AIOps Platforms” https://www.gartner.com/reviews/market/aiops-platforms?utm_source=chatgpt.com

- Cloud Monitoring: What It Is & How It Works https://www.splunk.com/en_us/blog/learn/cloud-monitoring.html?utm_source=chatgpt.com

- A Complete Guide to Cloud Monitoring https://www.liquidweb.com/blog/cloud-monitoring/?utm_source=chatgpt.com